2024年6月15日,由国内多家顶尖网络安全机构联合主办的“智见破境——2024网络安全运营实战大会”在北京国家会议中心隆重开幕。本次大会以“实战驱动,智御未来”为核心主题,汇聚了来自政府、企业、高校及研究机构的数千名网络安全专家、学者与从业者,共同探讨在人工智能技术浪潮下,网络安全运营面临的新形势、新挑战与实战解决方案。其中,人工智能基础软件(AI Infrastructure Software)的安全开发与治理,成为本届大会最受关注的前沿焦点。

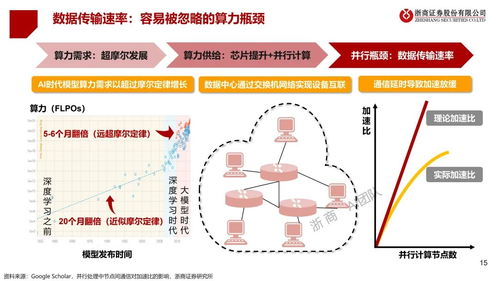

随着ChatGPT等生成式人工智能的爆发式应用,人工智能技术已深度渗透至各行各业的核心业务系统。作为AI模型训练、部署与运行的底层支撑,人工智能基础软件——包括机器学习框架(如TensorFlow, PyTorch)、大规模数据处理平台、模型服务平台及各类AI开发工具链——其安全性直接关系到上层AI应用的可靠性与整个数字生态的稳定。AI基础软件在带来巨大效能提升的也因其复杂性、开源依赖性及新型架构特点,引入了前所未有的安全风险。

在大会主论坛上,中国工程院院士、网络安全专家李明教授发表了题为《筑牢智能时代的安全基座:AI基础软件开发生命周期安全》的主旨演讲。他指出:“人工智能基础软件已构成数字社会的‘新基建’。其安全漏洞不仅可能导致模型被投毒、数据泄露、服务中断等传统风险,更可能引发模型偏见固化、决策逻辑被恶意操控等新型系统性风险。我们必须将安全能力‘左移’,深度嵌入AI基础软件的需求设计、代码开发、供应链管理及持续运营的全生命周期之中。”

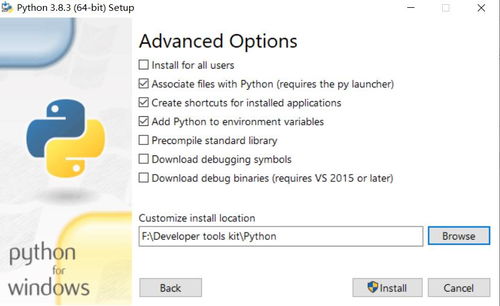

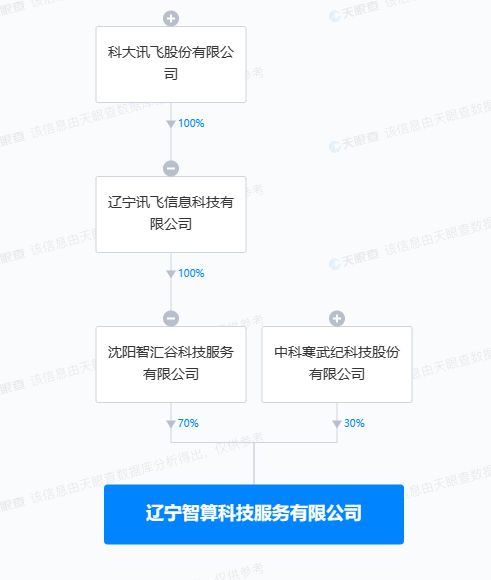

本次大会特设“AI基础软件安全”专题分论坛,议题深入且极具实战性。来自头部科技公司的安全实验室负责人分享了他们在自研AI框架中实施“安全-by-Design”原则的实践,包括在软件架构层面集成机密计算、差分隐私保护模块,以及建立针对AI模型的专项模糊测试(Fuzzing)与对抗样本检测体系。多家专注于软件供应链安全的厂商展示了针对AI开源组件(如Hugging Face模型库、PyPI中的AI相关包)的自动化漏洞与后门扫描方案,以应对日益严峻的供应链攻击威胁。

与会专家们热烈讨论了AI基础软件开发带来的新挑战:

- 复杂性挑战:AI软件栈层次多、技术新,传统安全工具和方法存在盲区,需要发展适应AI特性的新型安全分析技术。

- 数据与模型安全:训练数据污染、模型窃取与逆向攻击成为新的攻击面,要求基础软件具备更强的数据溯源和模型保护能力。

- 合规与伦理挑战:随着全球对AI监管的加强(如欧盟《人工智能法案》),基础软件开发必须内置可解释性、公平性审计与合规性验证接口。

- 人才缺口:兼具深厚AI技术理解与网络安全实战能力的“AI安全工程师”极为稀缺,成为产业发展的关键瓶颈。

为促进产、学、研、用协同,大会现场发布了《人工智能基础软件安全开发实践指南(2024)》征求意见稿,并启动了“AI安全开源组件共创计划”,旨在联合产业力量,共同构建更安全、可信的AI软件开发环境。

“智见破境”2024网络安全运营实战大会的成功举办,标志着中国网络安全产业正将战略目光投向更深层的技术基础。在人工智能定义软件的新时代,确保AI基础软件的安全,已不仅仅是技术问题,更是关乎国家数字主权、经济安全与社会稳定的战略议题。大会凝聚的共识与展示的实战成果,将为各行各业安全地拥抱人工智能、筑牢智能时代的数字防线提供至关重要的思路与路径。